Willkommen

Willkommen |

|

|

myGully

myGully |

|

|

Links

Links |

|

|

Forum

Forum |

|

|

|

|

|

16.02.23, 15:30

16.02.23, 15:30

|

#1

|

|

working behind bars

Registriert seit: Apr 2013

Beiträge: 3.222

Bedankt: 13.797

|

Automatisierte Datenanalyse

Automatisierte Datenanalyse

Wieder einmal muss das Bundesvefassungsgericht ausufernde Überwachungspläne stoppen:

Zitat:

Urteil des Bundesverfassungsgerichts: Automatisierte Datenanalyse für die vorbeugende Bekämpfung von Straftaten ist verfassungswidrig

Das Bundesverfassungsgericht erklärt die automatisierte Datenauswertung durch die Polizei in Hamburg und Hessen für nichtig beziehungsweise verfassungswidrig. Die Karlsruher Richter setzen damit der digitalen Rasterfahndung und dem sogenannten Predictive Policing Grenzen.

Wie sich eine KI polizeiliche Datenauswertung vorstellt. (Diffusion Bee)

Heute erging beim Bundesverfassungsgericht in Karlsruhe ein Urteil zum Einsatz automatisierter Datenauswertung bei der Polizei. Der Erste Senat erklärte die entsprechende Hamburger Regelung für nichtig und die hessische Befugnis für verfassungswidrig.

Laut der Karlsruher Richter dürfe die Polizei zwar grundsätzlich mit Hilfe einer Software Informationen und Querverbindungen zu Personen herstellen, um damit Straftaten vorzubeugen. Allerdings müssten Gesetze klare Vorgaben dazu machen, unter welchen Bedingungen dieses Data Mining erfolgt. Andernfalls verstießen die Regelungen gegen die informationelle Selbstbestimmung, also das Recht, über die eigenen Daten zu bestimmen. Laut der Richter liege ein Grundrechtseingriff „nicht nur in der weiteren Verwendung vormals getrennter Daten, sondern darüber hinaus in der Erlangung besonders grundrechtsrelevanten neuen Wissens, das durch die automatisierte Datenauswertung oder -analyse geschaffen werden kann.“

Das Bundesverfassungsgericht gibt damit in weiten Teilen zwei Verfassungsbeschwerden der Gesellschaft für Freiheitsrechte (GFF) und weiterer Bürgerrechtsorganisationen statt. Bijan Moini, Leiter des Legal Teams der GFF und Prozessbevollmächtigter, betont die weitreichende Bedeutung der heutigen Entscheidung: „Das Bundesverfassungsgericht hat heute der Polizei den ungehinderten Blick in die Glaskugel untersagt und strenge Vorgaben für den Einsatz von intelligenter Software in der Polizeiarbeit formuliert. Das war wichtig, weil die Automatisierung von Polizeiarbeit gerade erst begonnen hat.“

Predictive Policing mit Palantirs Hilfe

Konkret ging es in dem Verfahren um Paragraf 25a Abs. 1 Alt. 1 des Hessischen Gesetzes über die öffentliche Sicherheit und Ordnung (HSOG) sowie Absatz 49 Abs. 1 Alt. 1 des Hamburgischen Gesetzes über die Datenverarbeitung der Polizei (HmbPolDVG).

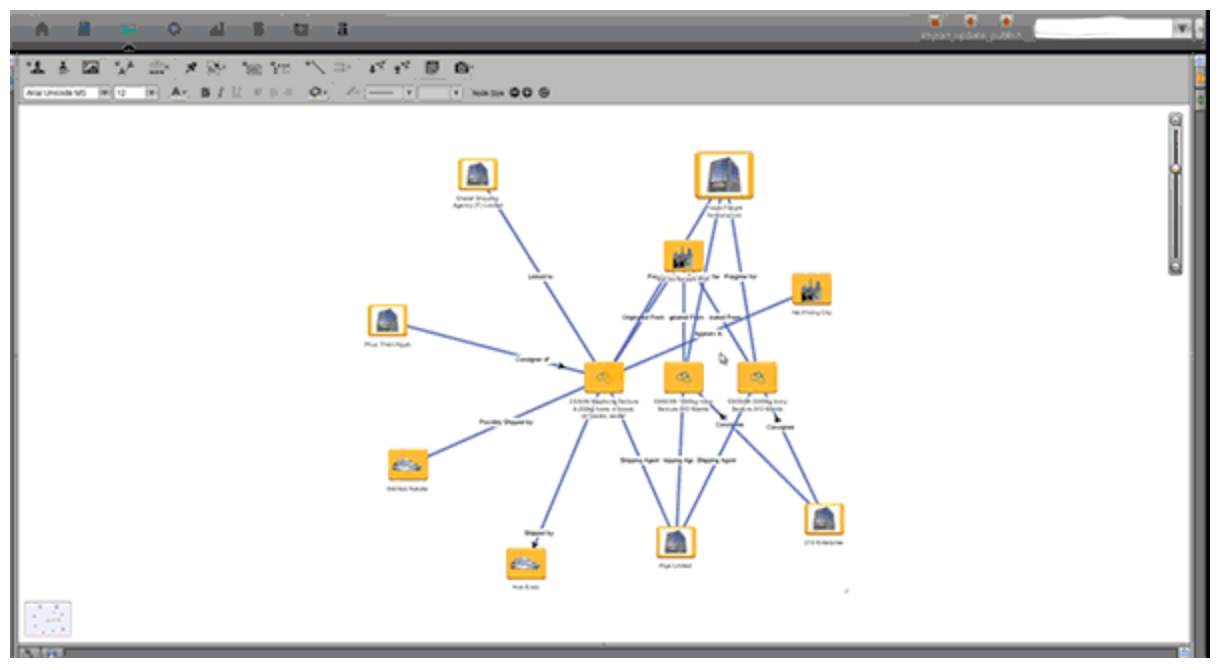

Die beiden Landespolizeigesetze erlauben eine umfangreiche Datenauswertung ähnlich einer Rasterfahndung und auch ein sogenanntes Predictive Policing, also den Versuch, aus vorhandenen polizeilichen Daten Vorhersagen abzuleiten. Die dafür eingesetzte Software soll Verbindungen zwischen Menschen, Objekten und polizeilich festgehaltenen Sachverhalten finden und sie für die Polizei visualisieren. Dazu verwendet sie unter anderem Kontaktdaten sowie Bewegungs- und Reiseinformationen. In Hessen werden zudem massenhaft Daten aus Funkzellenabfragen genutzt. All diese Daten werden miteinander verknüpft. Die Anbieter der eingesetzten Software versprechen, auf diese Weise gänzlich neue Ermittlungsansätze generieren zu können.

Die vom Bundesverfassungsgericht gerügte gesetzliche Grundlage für die Datenerhebung, -verknüpfung und -auswertung wird mit Hilfe kommerzieller Dienstleister umgesetzt. Im Falle von Hessen wurde das US-Unternehmen Palantir Technologies beauftragt. Es importiert aus den polizeilichen Quellsystemen die Daten in eine Analyseplattform und stellt der Polizei Hessen ein Nutzungsinterface zur Verfügung. Palantirs Software „Gotham“ firmiert bei der Polizei Hessen unter dem Namen „HessenDATA“. In Hamburg befindet sich die technische Umsetzung derzeit in der Planung.

Weder die technischen Details rund um die Software noch um die Verträge mit dem US-Unternehmen Palantir sind öffentlich bekannt. Die Karlsruher Richter haben diese in dem Verfahren auch nicht näher beleuchtet. Zwar brachte die mündliche Anhörung im Dezember einige Fakten über den Umfang der analysierten Daten und die praktische Anwendung im Polizeialltag ans Tageslicht. Diese beschränkten sich jedoch auf die polizeiliche Nutzersicht auf Palantirs Software. Eine geplante Überprüfung der technischen Details von Palantirs Analysesoftware durch das Fraunhofer-Institut für Sichere Informationstechnologie verzögerte sich.

Screenshot eines Gotham-Werbevideos von Palantir.

Die GFF erhob die Verfassungsbeschwerden gemeinsam mit der Humanistischen Union, den Datenschützern Rhein Main, dem Forum InformatikerInnen für Frieden und gesellschaftliche Verantwortung, den Kritischen Jurastudierenden Hamburg, der Vereinigung Demokratischer Juristinnen und Juristen, dem AStA der Universität Hamburg und der Deutschen Journalistinnen- und Journalisten-Union (dju). Die Beschwerdeschrift zu den hessischen Normen verfasste Professor Tobias Singelnstein, die Beschwerdeschrift zu den hamburgischen Normen Junior-Professor Sebastian Golla.

Quelle mit weiteren Links:[ Link nur für registrierte Mitglieder sichtbar. Bitte einloggen oder neu registrieren ]

|

Pressemitteilung Bundesverfassungsgericht:[ Link nur für registrierte Mitglieder sichtbar. Bitte einloggen oder neu registrieren ]

|

|

|

|

Die folgenden 5 Mitglieder haben sich bei Uwe Farz bedankt:

|

|

16.02.23, 23:53

16.02.23, 23:53

|

#2

|

|

working behind bars

Registriert seit: Apr 2013

Beiträge: 3.222

Bedankt: 13.797

|

Ergänzend noch ein Kommentar von Constanze Kurz, die technische Sachverständige in dem Beschwerdeverfahren war:

Zitat:

Automatisierte Datenanalyse: Der Wilde Westen beim Data-Mining der Polizei ist vorbei

Das heutige Karlsruher Urteil ist ein Sieg für das Grundrecht auf informationelle Selbstbestimmung. Künftige Gesetze zur polizeilichen Datenanalyse müssen neue Vorgaben erfüllen, um zu starke Eingriffe der Polizei in die Privatsphäre Betroffener zu vermeiden. Ein Kommentar.

16.02.2023 um 16:44 Uhr - Constanze - in Überwachung - eine Ergänzung

Wie eine Künstliche Intelligenz das Profiling von Menschen visualisiert (Diffusion Bee)

Die bislang praktizierte automatisierte Datenauswertung bei der Polizei ist verfassungswidrig, entschied heute das Bundesverfassungsgericht. Natürlich ist das Urteil (pdf) ein Sieg für alle, die das Grundrecht auf informationelle Selbstbestimmung wertschätzen. Denn die Praxis, es durch absichtliche gesetzliche Nicht-Regelung allein der Polizei und deren Dienstleistern zu überlassen, wie weit sie in die Grundrechte von Bürgern eingreifen, ist heute faktisch beendet worden. Beide angegriffenen Regelungen aus Hamburg und Hessen sind zwar verfassungswidrig, allerdings bekommt Hessen eine Gnadenfrist bis September, um nachzubessern. Damit dürfte diese Nachbesserung bei der polizeilichen Datenanalyse in Hessen auch gleich zum Wahlkampfthema werden.

Das Gericht hat die Chance nicht verstreichen lassen, sich mit dem Einsatz von Technologien des maschinellen Lernens und auch prognostischer Software genauer auseinanderzusetzen. Schließlich fehlen in beiden gekippten Gesetzen technische und rechtliche Vorgaben, die das Gericht nun einfordert. Künftige gesetzliche Regelungen der automatisierten Datenanalyse werden nicht nur sehr viel detaillierter ausgestaltet und mit Blick auf die genutzten polizeilichen Datenquellen neu austariert werden müssen, um darzulegen, was konkret die Polizei beim Data-Mining darf und was nicht. Zusätzlich müssen sie auch neue Vorgaben des Gerichts erfüllen, welches die verlässliche Dokumentation von Informationen über die Datenanalyse-Software „in einer öffentlich zugänglichen Weise“ verlangt.

Die Anhörung im Dezember drehte sich vor allem um die Ausgestaltung eines konkreten Softwareproduktes des kommerziellen Unternehmens Palantir. Das bedient seit Jahren Polizei, Geheimdienste und Militär und hat vor einigen Jahren auch die deutschen Polizeien als lukrativen Markt entdeckt. Mit allzu anstrengenden Forderungen nach Transparenz oder auch nur sinnvollen Erklärungen dazu, was die teure Software denn technisch tatsächlich leistet oder was die Verträge mit der Polizei besagen, war Palantir bisher nicht konfrontiert. Das wird das heutige Urteil teilweise ändern, da es für die künftige Umsetzung von gesetzlichen Grundlagen fordert, dass die zuständigen Behörden sie nachvollziehbar dokumentieren und veröffentlichen.

Einschränkungen bei Massendatennutzung

Glaubt man der PR des Unternehmens, handelt es sich eine quasi-magische Software, unverzichtbar für Ermittler. In gewisser Weise spiegelt sich diese Darstellung auch im Urteil. Dass die Polizei seit Jahren solche Software einsetzt, trägt offenbar dazu bei, dass die Nutzung von automatisierter Datenanalyse nicht mehr als solche hinterfragt wird. Es hat sich in den Köpfen festgesetzt: Ohne solche digitalen Auguren könne eine moderne Polizei gar nicht mehr auskommen.

Obwohl der Fokus seitens des Gerichts in der Anhörung stark auf die spezielle Palantir-Anwendung in Hessen gerichtet war, erinnert das Urteil daran, was die gesetzlichen Befugnisse eigentlich erlaubt hätten. Denn was die Gesetze angeht, waren die polizeilichen Nutzer durch nichts daran gehindert, noch invasivere Technologien einzusetzen und auch noch ganz andere Datenarten zu verarbeiten als das aktuell praktiziert wird. Natürlich muss einer gesetzlichen Erlaubnis immer auch eine gewisse Technologienoffenheit innewohnen, allerdings konnte die Polizei qua Gesetz qualitativ und quantitativ ganz neue Kapitel aufschlagen.

In der Sprache des Gerichts heißt das „daten- und methodenoffene Ausgestaltung“. Mit diesem Wilden Westen beim Data-Mining der Polizei dürfte zunächst Schluss sein, insbesondere auch bei der Massendatennutzung wie bei den Funkzelleninformationen oder was beispielsweise biometrische Daten angeht. Deren Ausschluss bei der Datenanalyse benennt das Urteil explizit als eingriffsmildernd. Daten aus heimlicher Wohnraumüberwachung, von Staatstrojanereinsätzen oder ähnlich eingriffsintensiven Maßnahmen werden künftig nicht in den Systemen von Palantir landen.

Das Urteil fällt in eine Zeit, in der über Künstliche Intelligenz wieder viel gesprochen wird. Man kann sich über den Hype wundern und als technisch Interessierter auch manchmal darüber lachen: Aber aktuell wird vielen Menschen durch das Beispiel ChatGPT sehr bewusst, dass maschinelles Lernen in den Alltag eindringen wird. Da stellt sich durchaus die Frage, warum das Bundesverfassungsgericht zu Fragen des Einsatzes der Künstlichen Intelligenz bei der Polizei nicht grundsätzlicher wird. Es ist ja nicht so, als stünden diese Fragen nicht vor der Tür.

Doch im Grunde liefert das Urteil zahlreiche Details dazu, wie künftige Gesetzgeber Befugnisse bei der automatisierten Datenanalyse zu gestalten haben, was dabei „eingriffsverstärkend“, was „eingriffsmildernd“ ist und auch, wo die roten Linien verlaufen. Es wird und muss in Zukunft eine Art obere Grenze der Datenfracht geben, mit der eine Polizei-KI gefüttert werden darf, und auch eine qualitative Grenze in Bezug auf die Art der Daten. Dazu liegen nun detailreiche verfassungsrechtliche Anforderungen vor, an die sich Gesetzgeber zu halten haben. Das Gericht dürfte dennoch nicht das letzte Mal mit Fragen der automatisierten Datenanalyse beschäftigt sein, denn die Erfahrung lehrt: Gesetzgeber haben die Tendenz, sich an die Vorgaben aus Karlsruhe nicht immer zu halten.

|

Quelle:[ Link nur für registrierte Mitglieder sichtbar. Bitte einloggen oder neu registrieren ]

|

|

|

|

Die folgenden 5 Mitglieder haben sich bei Uwe Farz bedankt:

|

|

Forumregeln

Forumregeln

|

Du kannst keine neue Themen eröffnen

Du kannst keine Antworten verfassen

Du kannst keine Anhänge posten

Du kannst nicht deine Beiträge editieren

HTML-Code ist Aus.

|

|

|

Alle Zeitangaben in WEZ +1. Es ist jetzt 01:27 Uhr.

().

|